目录

2、Kubernates+Docker+Jenkins持续集成架构图

3、Kubernates+Docker+Jenkins持续集成方案好处

1、传统Jenkins的Master-Slave方案的缺陷

①Master节点发生单点故障时,整个流程都不可用了

②每个 Slave节点的配置环境不一样,来完成不同语言的编译打包等操作,但是这些差异化的配置导致管理起来非常不方便,维护起来也是比较费劲

③资源分配不均衡,有的 Slave节点要运行的job出现排队等待,而有的Slave节点处于空闲状态

④资源浪费,每台 Slave节点可能是实体机或者VM,当Slave节点处于空闲状态时,也不会完全释放掉资源

以上种种问题,我们可以引入Kubernates来解决!

2、Kubernates+Docker+Jenkins持续集成架构图

大致工作流程:手动/自动构建 -> Jenkins 调度 K8S API?->动态生成 Jenkins Slave pod?-> Slave pod 拉取 Git 代码/编译/打包镜像 ->推送到镜像仓库 Harbor?-> Slave 工作完成,Pod 自动销毁 ->部署到测试或生产 Kubernetes平台。(完全自动化,无需人工干预)

3、Kubernates+Docker+Jenkins持续集成方案好处

服务高可用:当 Jenkins Master 出现故障时,Kubernetes 会自动创建一个新的 Jenkins Master容器,并且将 Volume 分配给新创建的容器,保证数据不丢失,从而达到集群服务高可用。

动态伸缩,合理使用资源:每次运行 Job 时,会自动创建一个 Jenkins Slave,Job 完成后,Slave 自动注销并删除容器,资源自动释放,而且 Kubernetes 会根据每个资源的使用情况,动态分配Slave 到空闲的节点上创建,降低出现因某节点资源利用率高,还排队等待在该节点的情况。

扩展性好:当 Kubernetes 集群的资源严重不足而导致 Job 排队等待时,可以很容易的添加一个Kubernetes Node 到集群中,从而实现扩展。

4、Kubeadm安装Kubernetes

Kubernetes的架构

API ?Server:用于暴露Kubernetes ?API,任何资源的请求的调用操作都是通过kube-apiserver提供的接口进行的。

Etcd:是Kubernetes提供默认的存储系统,保存所有集群数据,使用时需要为etcd数据提供备份计划。

Controller-Manager:作为集群内部的管理控制中心,负责集群内的Node、Pod副本、服务端点(Endpoint)、命名空间(Namespace)、服务账号(ServiceAccount)、资源定额(ResourceQuota)的管理,当某个Node意外宕机时,Controller Manager会及时发现并执行自动化修复流程,确保集群始终处于预期的工作状态。

Scheduler:监视新创建没有分配到Node的Pod,为Pod选择一个Node。

Kubelet:负责维护容器的生命周期,同时负责Volume和网络的管理。

Kube proxy:是Kubernetes的核心组件,部署在每个Node节点上,它是实现Kubernetes Service的通信与负载均衡机制的重要组件。

5、安装环境说明

| 主机名称 | IP地址 | 安装的软件 |

| 代码托管服务器 | 192.168.100.128 | Gitlab-12.4.2 |

| Docker仓库服务器 | 192.168.100.133 | Harbor1.9.2 |

| k8s-master | 192.168.100.130 | kube-apiserver、kube-controller-manager、kube- scheduler、docker、etcd、calico,NFS |

| k8s-node1 | 192.168.100.131 | kubelet、kubeproxy、Docker18.06.1-ce |

| k8s-node2 | 192.168.100.132 | kubelet、kubeproxy、Docker18.06.1-ce |

三台服务器都需要配置docker环境(已完成)

[root@localhost ~]# systemctl stop ?rewalld

[root@localhost ~]# systemctl disable ?rewalld

[root@localhost ~]# setenforce 0

为了能方便区分,定义服务器的名称

hostnamectl set-hostname k8s-master

hostnamectl set-hostname k8s-node1

hostnamectl set-hostname k8s-node2修改hosts文件

[root@localhost ~]# vim /etc/hosts

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4

::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

192.168.100.130 k8s-master

192.168.100.131 k8s-node1

192.168.100.132 k8s-node2

设置系统参数,加载br_netfilter模块

[root@localhost ~]# modprobe br_netfilter设置允许路由转发,不对bridge的数据进行处理创建文件

[root@localhost ~]# vim /etc/sysctl.d/k8s.conf

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

net.ipv4.ip_forward = 1

vm.swappiness = 0执行文件?

[root@localhost ~]# sysctl -p /etc/sysctl.d/k8s.conf

kube-proxy开启ipvs的前置条件

[root@localhost ~]# cat > /etc/sysconfig/modules/ipvs.modules <<EOF

#!/bin/bash

modprobe -- ip_vs

modprobe -- ip_vs_rr

modprobe -- ip_vs_wrr

modprobe -- ip_vs_sh

modprobe -- nf_conntrack_ipv4

EOF设置执行权限

[root@localhost ~]# chmod 755 /etc/sysconfig/modules/ipvs.modules && bash用过滤的方式查看刚才的配置是否生效

[root@localhost ~]# /etc/sysconfig/modules/ipvs.modules && lsmod | grep -e ip_vs -e nf_conntrack_ipv4

ip_vs_sh 12688 0

ip_vs_wrr 12697 0

ip_vs_rr 12600 0

ip_vs 145497 6 ip_vs_rr,ip_vs_sh,ip_vs_wrr

nf_conntrack_ipv4 15053 2

nf_defrag_ipv4 12729 1 nf_conntrack_ipv4

nf_conntrack 133095 7 ip_vs,nf_nat,nf_nat_ipv4,xt_conntrack,nf_nat_masquerade_ipv4,nf_conntrack_netlink,nf_conntrack_ipv4

libcrc32c 12644 4 xfs,ip_vs,nf_nat,nf_conntrack

关闭所有节点swap

[root@localhost ~]# swapo? -a #临时关闭

[root@localhost ~]# vim /etc/fstab #永久关闭注释掉以下字段

/dev/mapper/cl-swap swap swap defaults 0 0安装kubelet、kubeadm、kubectl

先清空yum缓存

[root@localhost ~]# yum clean all设置yum安装源

[root@localhost ~]# cat <<EOF > /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64/

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF开始安装

[root@localhost ~]# yum install -y kubelet-1.17.0 kubeadm-1.17.0 kubectl-1.17.0先设置开机自启动

[root@localhost ~]# systemctl enable kubeletMaster节点需要完成

运行初始化命令,ip根据自己的master地址修改

[root@k8s-master ~]# kubeadm init --kubernetes-version=1.17.0 \

--apiserver-advertise-address=192.168.100.130 \

--image-repository registry.aliyuncs.com/google_containers \

--service-cidr=10.1.0.0/16 \

--pod-network-cidr=10.244.0.0/16加载完成后,根据提示输入命令

启动kubelet服务

[root@k8s-master ~]# systemctl restart kubelet

[root@k8s-master ~]# systemctl status kubelet

● kubelet.service - kubelet: The Kubernetes Node Agent

Loaded: loaded (/usr/lib/systemd/system/kubelet.service; enabled; vendor preset: disabled)

Drop-In: /usr/lib/systemd/system/kubelet.service.d

└─10-kubeadm.conf

Active: active (running) since 二 2022-03-08 00:29:03 CST; 8min ago

Docs: https://kubernetes.io/docs/

Main PID: 82931 (kubelet)

Tasks: 19

Memory: 33.5M

CGroup: /system.slice/kubelet.service

└─82931 /usr/bin/kubelet --bootstrap-kubeconfig=/etc/kubernetes/bootstrap-kubelet.con...安装Calico

[root@k8s-master ~]# mkdir k8s

[root@k8s-master ~]# cd k8s/

[root@k8s-master k8s]# wget --no-check-certificate https://docs.projectcalico.org/v3.10/getting-started/kubernetes/installation/hosted/kubernetes-datastore/calico-networking/1.7/calico.yaml地址更改,方便从节点通信

[root@k8s-master k8s]# sed -i 's/192.168.0.0/10.244.0.0/g' calico.yaml

[root@k8s-master k8s]# kubectl apply -f calico.yaml查看所有Pod的状态,确保所有Pod都是Running状态

[root@k8s-master k8s]# kubectl get pod --all-namespaces -o wide

Slave节点需要完成

让所有节点让集群环境,使用之前Master节点产生的命令加入集群

kubeadm join 192.168.100.130:6443 --token 21wl8e.p6uv8lqwyhc2pld0 \

? ? --discovery-token-ca-cert-hash sha256:910ff2a3d463b27ef7db0a1d6dda399824eee67c29a72beef4764c0b409ab71d?启动kubele服务

[root@k8s-node1 ~]# systemctl start kubelet

[root@k8s-node1 ~]# systemctl status kubelet

● kubelet.service - kubelet: The Kubernetes Node Agent

Loaded: loaded (/usr/lib/systemd/system/kubelet.service; enabled; vendor preset: disabled)

Drop-In: /usr/lib/systemd/system/kubelet.service.d

└─10-kubeadm.conf

Active: active (running) since 二 2022-03-08 00:53:28 CST; 3min 36s ago

Docs: https://kubernetes.io/docs/

Main PID: 79584 (kubelet)

Tasks: 19

Memory: 35.1M

CGroup: /system.slice/kubelet.service

└─79584 /usr/bin/kubelet --bootstrap-kubeconfig=/etc/kubernetes/bootstrap-kubelet.con...[root@k8s-node2 ~]# systemctl start kubelet

[root@k8s-node2 ~]# systemctl status kubelet

● kubelet.service - kubelet: The Kubernetes Node Agent

Loaded: loaded (/usr/lib/systemd/system/kubelet.service; enabled; vendor preset: disabled)

Drop-In: /usr/lib/systemd/system/kubelet.service.d

└─10-kubeadm.conf

Active: active (running) since 二 2022-03-08 00:53:52 CST; 3min 21s ago

Docs: https://kubernetes.io/docs/

Main PID: 79532 (kubelet)

Tasks: 20

Memory: 34.1M

CGroup: /system.slice/kubelet.service

└─79532 /usr/bin/kubelet --bootstrap-kubeconfig=/etc/kubernetes/bootstrap-kubelet.con...回到Master节点查看,如果Status全部为Ready,代表集群环境搭建成功!!!

[root@k8s-master ~]# kubectl get nodes

NAME STATUS ROLES AGE VERSION

k8s-master Ready master 32m v1.17.0

k8s-node1 Ready <none> 5m5s v1.17.0

k8s-node2 Ready <none> 4m41s v1.17.06、安装和配置NFS和harbor配置

NFS简介:NFS(Network File System),它最大的功能就是可以通过网络,让不同的机器、不同的操作系统可以共享彼此的文件。我们可以利用NFS共享Jenkins运行的配置文件、Maven的仓库依赖文件等。

安装NFS(三台服务器都需安装)

[root@localhost ~]# yum install -y nfs-utils三台k8s服务器都需配置harbor配置?

[root@localhost ~]# vim /etc/docker/daemon.json

{

"insecure-registries": ["192.168.100.133:85"],

"registry-mirrors": ["https://05vz3np5.mirror.aliyuncs.com"]

}

在master服务器上创建共享目录

[root@k8s-master ~]# mkdir -p /opt/nfs/jenkins

[root@k8s-master ~]# vim /etc/exports #编写NFS的共享配置

/opt/nfs/jenkins *(rw,no_root_squash) #共享之前的路径和不降权

[root@k8s-master ~]# systemctl enable nfs #开机自启动

[root@k8s-master ~]# systemctl start nfs #启动服务在node节点查看NFS共享目录

[root@k8s-node1 ~]# showmount -e 192.168.100.130

Export list for 192.168.100.130:

/opt/nfs/jenkins *

[root@k8s-node2 ~]# showmount -e 192.168.100.130

Export list for 192.168.100.130:

/opt/nfs/jenkins *7、在Kubernetes安装Jenkins-Master

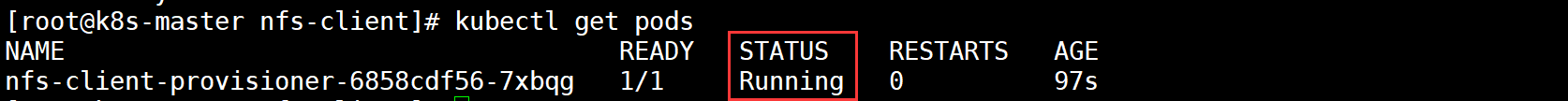

创建NFS client provisioner

nfs-client-provisioner 是一个Kubernetes的简易NFS的外部provisioner,本身不提供NFS,需要现有的NFS服务器提供存储。

修改deployment.yaml,使用之前配置NFS服务器和目录

构建nfs-client-provisioner的pod资源

[root@k8s-master ~]# cd nfs-client/

[root@k8s-master nfs-client]# kubectl create -f .查看pod是否创建成功

安装 Jenkins-Master

其中有两点注意:

第一、在StatefulSet.yaml文件,声明了利用nfs-client-provisioner进行Jenkins-Master文件存储

第二、Service发布方法采用NodePort,会随机产生节点访问端口

创建kube-ops的namespace

因为我们把Jenkins-Master的pod放到kube-ops下

[root@k8s-master jenkins-master]# kubectl create namespace kube-ops

namespace/kube-ops created构建Jenkins-Master的pod资源

[root@k8s-master ~]# cd jenkins-master/

[root@k8s-master jenkins-master]# kubectl create -f .

[root@k8s-master jenkins-master]# kubectl get pods -n kube-ops

NAME READY STATUS RESTARTS AGE

jenkins-0 0/1 Running 0 48s

[root@k8s-master jenkins-master]# kubectl describe pods -n kube-ops

Name: jenkins-0

Namespace: kube-ops #空间名字为kube-ops

Priority: 0

Node: k8s-node2/192.168.100.132 #在node2节点上查看信息,并访问查看Pod运行在那个Node上

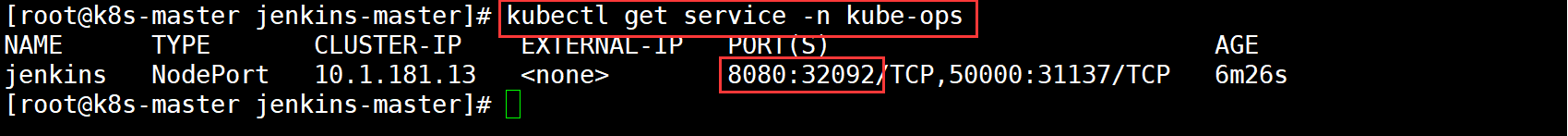

查看分配的端口

最终访问地址为:http://192.168.100.132:32092

根据提供的地址找到Jenkins密钥

进入jenkins界面

设置插件下载地址

[root@k8s-master kube-ops-jenkins-home-jenkins-0-pvc-23eb6ff2-a394-48c8-99e1-493c786dffc5]# cd updates/

[root@k8s-master updates]# sed -i 's/http:\/\/updates.jenkins- ci.org\/download/https:\/\/mirrors.tuna.tsinghua.edu.cn\/jenkins/g' default.json && sed -i 's/http:\/\/www.google.com/https:\/\/www.baidu.com/g' default.jsonManage Plugins点击Advanced,把Update Site改为国内插件下载地址

https://mirrors.tuna.tsinghua.edu.cn/jenkins/updates/update-center.json

先安装基本插件

Chinese、Git、Pipeline、Extended Choice Parameter 四个插件安装完成重启Jenkins。

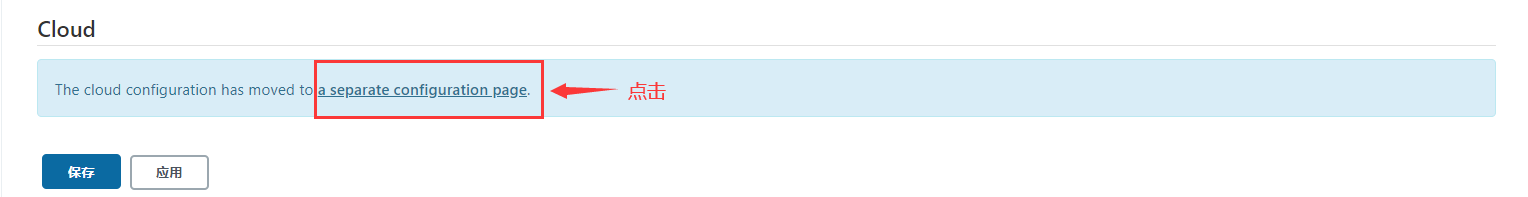

8、Jenkins与Kubernetes整合

安装Kubernetes插件

系统管理->系统配置->云->新建云->Kubernetes

kubernets 的地址:https://kubernetes.default.svc.cluster.local

Jenkins URL地址:http://jenkins.kube-ops.svc.cluster.local:8080

9、构建Jenkins-Slave自定义镜像

Jenkins-Master在构建Job的时候,Kubernetes会创建Jenkins-Slave的Pod来完成Job的构建。我们选择运行Jenkins-Slave的镜像为官方推荐镜像:jenkins/jnlp-slave:latest,但是这个镜像里面并没有Maven环境,为了方便使用,我们需要自定义一个新的镜像:

![]()

Docker?le文件内容如下:?

FROM jenkins/jnlp-slave:latest

MAINTAINER kgc

# 切换到 root 账户进行操作

USER root

# 安装 maven

COPY apache-maven-3.6.2-bin.tar.gz .

RUN tar -zxf apache-maven-3.6.2-bin.tar.gz && \

mv apache-maven-3.6.2 /usr/local && \

rm -f apache-maven-3.6.2-bin.tar.gz && \

ln -s /usr/local/apache-maven-3.6.2/bin/mvn /usr/bin/mvn && \

ln -s /usr/local/apache-maven-3.6.2 /usr/local/apache-maven && \

mkdir -p /usr/local/apache-maven/repo

COPY settings.xml /usr/local/apache-maven/conf/settings.xml

USER jenkins开始构建镜像

镜像构建完成后开始上传

[root@k8s-master ~]# docker login -u admin -p Harbor12345 192.168.100.133:85 #先登录harbor仓库

[root@k8s-master ~]# docker tag jenkins-slave-maven:latest 192.168.100.133:85/library/jenkins-slave-maven:latest #给镜像打标签

[root@k8s-master ~]# docker push 192.168.100.133:85/library/jenkins-slave-maven:latest #用push方式进行推送

查看harbor仓库是否有推送的镜像

10、测试Jenkins-Slave是否可以创建

创建一个流水线项目进行测试

添加凭证

编写Pipeline,从GItlab拉取代码(使用http方式)

def git_address = "http://192.168.195.180:82/kgc_group/tensquare_back.git"

def git_auth = "f06c4b06-ac26-4683-ad00-2d3599c827ee"

//创建一个Pod的模板,label为jenkins-slave

podTemplate(label: 'jenkins-slave', cloud: 'kubernetes', containers: [

containerTemplate(

name: 'jnlp',

image: "192.168.195.183:85/library/jenkins-slave-maven:latest"

)

]

)

{

//引用jenkins-slave的pod模块来构建Jenkins-Slave的pod

node("jenkins-slave"){

stage('拉取代码'){

checkout([$class: 'GitSCM', branches: [[name: '*/master']], extensions: [], userRemoteConfigs: [[credentialsId: "${git_auth}", url: "${git_address}"]]])

}

}

}查看构建日志(创建的时候可以打开node管理查看临时节点)

可以看到当开始构建的时候出现了slave节点,所以是slave构建了项目,而项目构建完成后,slave节点就消失了。