һ��ELKǰ��

1)������Ҫ�ռ���Щ��־?

�ռ�ϵͳ��־:Ϊ�������,Ҫ�ռ�tomcatϵͳ��־,tomcat���ڽڵ����־

�ռ�������־:�������ݿ�mysql,�ռ�����ѯ��־��������־����ͨ��־,Ҫ�ռ�tomcat������־��

�ռ�ҵ����־(ҵ����־�����ռ�):ҵ�������־��log4j,log4j����java����������,����tomcat��

2)��־�ռ���,���չʾ(���ӻ�)?

kibana

grafana:�����Ե�ͼ�ķ�ʽչʾ,���ܸ�ȫ��һЩ,�����ÿ�һЩ

3)��־�ռ�չʾ������,��ôʹ��?

���ڸ������ݷ���,��Ϊ���廯չʾ��һ������Դ

���з�ȥʹ��(���ϡ����bug��)

ͳ����������,��Ϊ�������������Դ

4)����Ҫ��ô�ռ���־

������Ҫ������Ե�ȥ�ռ���־

��־�ռ��Ǹ����������õ���־����������,���ڲ��Ǻ���Ҫ����־,��־�������һ�㡣����error��ʱ����,��ͨ��־���ñ�������������Ч������־����������ҵ����־,���Dz��ʺϵ�error����,������Ҫ����warning����

����ELK���

2.1ElasticSearch����

Elasticsearch��һ������Lucene�����������������ṩ��һ���ֲ�ʽ���û�������ȫ����������,����RESTful web�ӿڡ�Elasticsearch����Java������,����ΪApache���������µĿ���Դ�뷢��,�ǵڶ����е���ҵ�������档��������Ƽ�����,�ܹ��ﵽʵʱ����,�ȶ�,�ɸ�,����,��װʹ�÷��㡣����

ElasticSearch���ĸ���

�ӽ�ʵʱ

ElasticSearch��һ���ӽ�ʵʱ������ƽ̨

�����˵,���Ǵ�����һ���ĵ�ֱ������ĵ��ܹ�����������һ�������ӳ�(ͨ����1��)

��Ⱥ��

��Ⱥÿһ̨�����������Լ���һ��Ψһ��ʶ,����˵id,��ʶ�Լ��ڼ�Ⱥ�е�һ����λ��

����Ⱥ������һ�������ڵ���֯��һ��,���ǹ�ͬ����������������,��һ���ṩ�������������ܡ�����һ���ڵ�Ϊ���ڵ�,������ڵ��ǿ���ͨ��ѡ�ٲ�����,���ṩ��ڵ�����������������Ĺ��ܡ�

�ڵ�

�ڵ����һ̨��һ�ķ�����,�Ǽ�Ⱥ��һ����,�洢���ݲ����뼯Ⱥ���������������ܡ���Ⱥһ��,�ڵ�Ҳ��ͨ����������ʶ,Ĭ�����ڽڵ�����ʱ���������ַ�������Ȼ,������Լ����塣������Ҳ����Ҫ,�ڼ�Ⱥ������ʶ���������Ӧ�Ľڵ㡣

����

һ����������һ��ӵ�м��������������ĵ��ļ��ϡ�����˵,�������һ���ͻ����ݵ�����,��һ����Ʒ��¼������,����һ���������ݵ�������һ��������һ����������ʶ(����ȫ����Сд��ĸ��),���ҵ�����Ҫ�Զ�Ӧ����������е��ĵ��������������������º�ɾ����ʱ��Ҫʹ�õ�������֡���һ����Ⱥ��,�������,���Զ���������������

����

��һ��������,����Զ���һ�ֻ�������͡�һ�����������������һ����.�ϵķ���/����,��������ȫ����������ͨ��,��Ϊ����һ�鹲ͬ�ֶε��ĵ�����һ�����͡�����˵,���Ǽ�������Ӫһ������ƽ̨���ҽ������е����ݴ洢��һ�������С������������,�����Ϊ�û����ݶ���һ������,Ϊ�������ݶ�����һ������,��Ȼ,Ҳ����Ϊ�������ݶ�����һ�����͡�

�ĵ�

һ���ĵ���һ���ɱ������Ļ�����Ϣ��Ԫ������,�����ӵ��ijһ���ͻ����ĵ�,ijһ����Ʒ��һ���ĵ�,��Ȼ,Ҳ����ӵ��ij��������һ���ĵ����ĵ���JSON ��ʽ����ʾ,��JSON��һ���������ڵĻ��������ݽ�����ʽ�� ��һ��index/type����,ֻҪ����,����Դ洢�������ĵ���ע��,��Ȼһ���ĵ���������λ��һ��������,ʵ����һ���ĵ�������һ�������ڱ������ͷ���һ�����͡�

��Ƭ����(Ĭ���������5����Ƭ��1������,����ζ��,�����ļ�Ⱥ�����������ڵ�,�������������5����Ƭ������5������,)

�����������,�����ڵ�Ĵ洢�������Լ�I/O��дЧ���Ǻ���������ƿ���ġ�Ϊ�����ƿ������,����������,���ڴ洢����һ���ֲ�ʽ,����ڵ���һ����������ߴ洢����,���������������,ͬʱ���Լ���ѹ����̯��

elasticsearch�ṩ�������ֳɶ����Ƭ�Ĺ��ܡ����ڴ�������ʱ,���Զ�����Ҫ��Ƭ��������ÿһ����Ƭ����һ��ȫ���ܵĶ���������,����λ�ڼ�Ⱥ���κνڵ��ϡ�

��Ƭ����������Ҫԭ��: a.�������չ������b������˵�����洢����,c.�ֲ�ʽ���п��Ƭ����,������ܺ�������

�ֲ�ʽ��Ƭ�Ļ��ƺ�����������ĵ���λ�����ȫ����elasticsearch���Ƶ�,��Щ���û����������ġ�

��������ȵ���������������κ�ʱ���ڶ���,Ϊ�˽�׳��,ǿ�ҽ���Ҫ��һ�������л�����,���ۺ��ֹ����Է�ֹ��Ƭ���߽ڵ㲻���á�

����Ҳ����������Ҫԭ��:a.�߿�����,��Ӧ�Է�Ƭ���߽ڵ���ϡ��������ԭ��,��Ƭ����Ҫ�ڲ�ͬ�Ľڵ��ϡ�b. �����˶�д����,�������������������Բ��������и�����ִ�С�

2.2ELK�����������

Logstash(��־�ռ�):��Ҫ�����ռ����������ʽ������

Elasticsearch(��־�洢������):���ڽ�������,��Ϊ���ĸ����ͷ�Ƭ,��������������ǿ��

Kibana(չʾ):��Ϊչʾ�õ�,չʾ�Ļ�������־�ռ�����es������������,�������kibana,ͨ��kibanaչ�ֳ��������ļ������ر�á�

2.3 ����һ���õ�ES�汾��ʲô?

7.10��7.20,������һ�����Ծ���,����ʱ,����Ϊ��root�û���es����ʱ�ܳ��ڴ档���һῨ�ܾá�

����ELK�Ĺ���ԭ��

(1)��������Ҫ�ռ���־�ķ������ϲ���Logstash; �����Ƚ���־���м��л���������־��������, ����־�������ϲ��� Logs tash��

(2)Logstash �ռ���־,����־��ʽ��������� Elasticsearch Ⱥ���С�

(3)Elasticsearch �Ը�ʽ��������ݽ��������ʹ洢��

(4)Kibana �� ES Ⱥ���в�ѯ��������ͼ��,������ǰ�����ݵ�չʾ��

�ġ�ELK��־����ϵͳ��Ⱥ����

����:

���������� ϵͳ��IP��ַ ��Ҫ��װ����� Ӳ������

Node1�ڵ� CentOS7.4(64 λ) 192.168.49.11 Elasticsearch �� Kibana 2��4G

Node2�ڵ� CentOS7.4(64 λ) 192.168.49.12 Elasticsearch 2��4G

Apache�ڵ� CentOS7.4(64 λ) 192.168.49.13 Logstash Apache 2��4G

4.1 ELK Elasticsearch ��Ⱥ����(��Node1��Node2�ڵ��ϲ���)

1.������

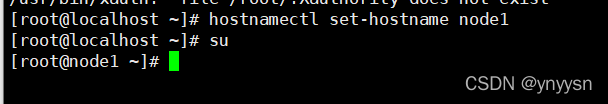

#����������

Node1�ڵ�:hostnamectl set-hostname node1

Node2�ڵ�:hostnamectl set-hostname node2

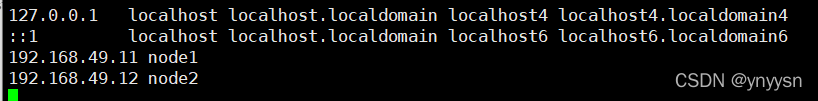

#������������

vim /etc/hosts

192.168.49.11 node1

192.168.49.12 node2

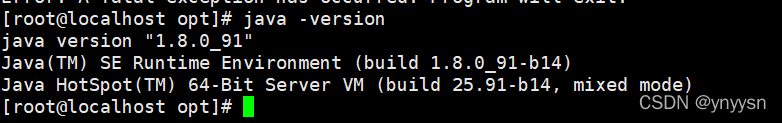

#�鿴Java����,���û�а�װ,yum -y install java

java -version

(1)����������

(2)������������

(3)�鿴Java����

2.���� Elasticsearch ����

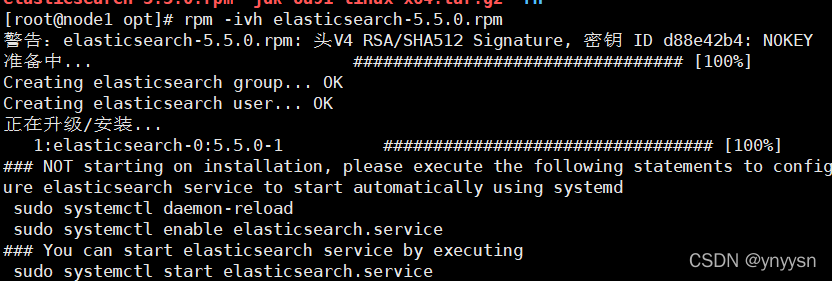

(1)#�ϴ�elasticsearch-5.5.0.rpm��/optĿ¼��

cd /opt

rpm -ivh elasticsearch-5.5.0.rpm

(2)#����ϵͳ����

systemctl daemon-reload

systemctl enable elasticsearch.service

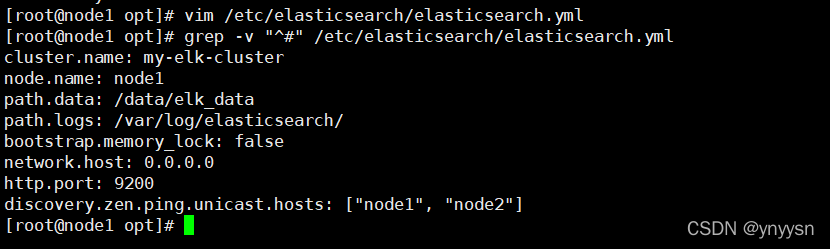

(3)#��elasticsearch�������ļ�

cp /etc/elasticsearch/elasticsearch.yml /etc/elasticsearch/elasticsearch.yml.bak

vim /etc/elasticsearch/elasticsearch.yml

--17--ȡ��ע��,ָ����Ⱥ����

cluster.name: my-elk-cluster

--23--ȡ��ע��,ָ���ڵ�����:Node1�ڵ�Ϊnode1,Node2�ڵ�Ϊnode2

node.name: node1

--33--ȡ��ע��,ָ�����ݴ��·��

path.data: /data/elk_data

--37--ȡ��ע��,ָ����־���·��

path.logs: /var/log/elasticsearch/

--43--ȡ��ע��,��Ϊ��������ʱ�������ڴ�

bootstrap.memory_lock: false

--55--ȡ��ע��,���ü�����ַ,0.0.0.0�������е�ַ

network.host: 0.0.0.0

--59--ȡ��ע��,ES �����Ĭ�ϼ����˿�Ϊ9200

http.port: 9200

--68--ȡ��ע��,��Ⱥ����ͨ������ʵ��,ָ��Ҫ���ֵĽڵ� node1��node2

discovery.zen.ping.unicast.hosts: ["node1", "node2"]

#�鿴�������ļ�

grep -v ��^#�� /etc/elasticsearch/elasticsearch.yml

#��node1�������ļ�����һ����node2�ϲ�ȥnode2����

scp /etc/elasticsearch/elasticsearch.yml node2:/etc/elasticsearch/

vim /etc/elasticsearch/elasticsearch.yml

�C23�Cȡ��ע��,ָ���ڵ�����:Node1�ڵ�Ϊnode1,Node2�ڵ�Ϊnode2

node.name: node2

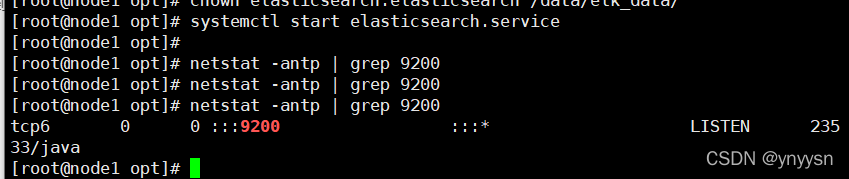

(4)#�������ݴ��·������Ȩ

mkdir -p /data/elk_data

chown elasticsearch:elasticsearch /data/elk_data/

(5)#����elasticsearch�Ƿ�ɹ�����

systemctl start elasticsearch.service

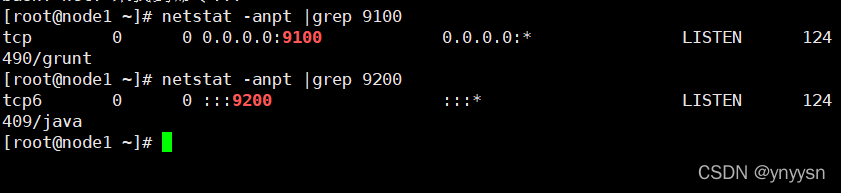

netstat -antp | grep 9200

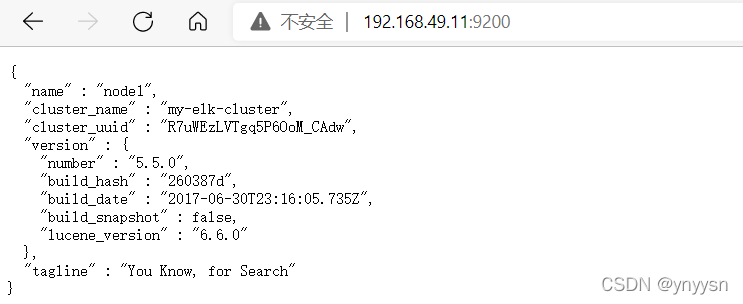

(6)#�鿴�ڵ���Ϣ

��������� ,�鿴�ڵ� Node1��Node2 ����Ϣ

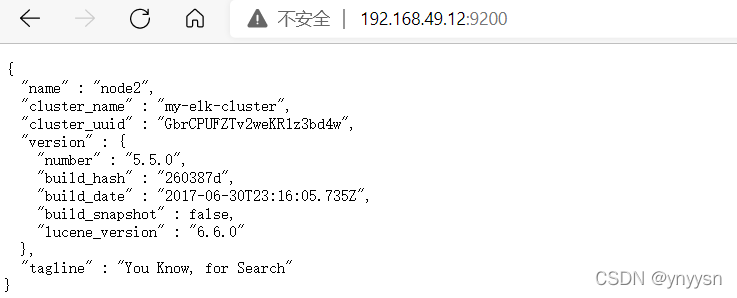

http://192.168.49.11:9200 http://192.168.49.12:9200

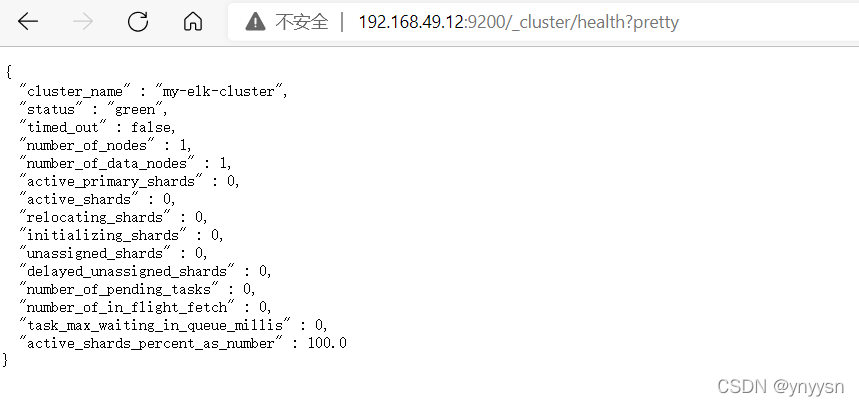

http://192.168.59.115:9200/_cluster/health?pretty

http://192.168.59.116:9200/_cluster/health?pretty

####### ʹ�����Ϸ�ʽ�鿴״̬�����Ѻ�,����ͨ�� elasticsearch-head�����ֱ�ӹ��� #####

3.��װ Elasticsearch-head ���

Elasticsearch �� 5.0 �汾��,Elasticsearch-head �����Ҫ��Ϊ����������а�װ,��Ҫʹ��npm����(NodeJS�İ���������)��װ��

��װ Elasticsearch-head ��Ҫ��ǰ��װ���������� node �� phantomjs��

node:��һ������ Chrome V8 ����� JavaScript ���л�����

phantomjs:��һ������ webkit ��JavaScriptAPI,��������Ϊһ�����ε������,�κλ��� webkit �������������,��������������

(1)#���밲װ node

#�ϴ������� node-v8.2.1.tar.gz ��/opt

yum install gcc gcc-c++ make -y

cd /opt

tar zxf node-v8.2.1.tar.gz

cd node-v8.2.1/

./configure

make -j2 && make install

(2)#��װ phantomjs

#�ϴ������� phantomjs-2.1.1-linux-x86_64.tar.bz2 ��

cd /opt

tar jxf phantomjs-2.1.1-linux-x86_64.tar.bz2 -C /usr/local/src/

cd /usr/local/src/phantomjs-2.1.1-linux-x86_64/bin

cp phantomjs /usr/local/bin

(3)#��װ Elasticsearch-head ���ݿ��ӻ�����

#�ϴ������� elasticsearch-head.tar.gz ��/opt

cd /opt

tar zxf elasticsearch-head.tar.gz -C /usr/local/src/

cd /usr/local/src/elasticsearch-head/

npm install

(4)#�� Elasticsearch �������ļ�

vim /etc/elasticsearch/elasticsearch.yml

��

�Cĩβ�����������ݨC

http.cors.enabled: true #�����������֧��,Ĭ��Ϊ false

http.cors.allow-origin: ��*�� #ָ���������������������ַΪ����

systemctl restart elasticsearch

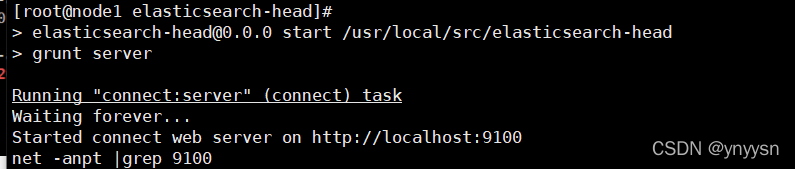

(5)#���� elasticsearch-head ����

#�����ڽ�ѹ��� elasticsearch-head Ŀ¼����������,���̻��ȡ��Ŀ¼�µ� gruntfile.js �ļ�,�����������ʧ�ܡ�

cd /usr/local/src/elasticsearch-head/

npm run start &

#elasticsearch-head �����Ķ˿��� 9100

netstat -natp |grep 9100

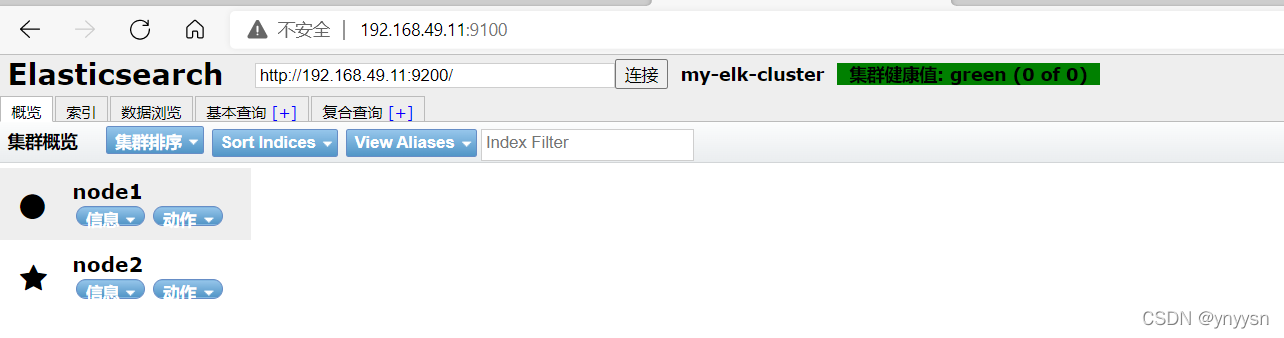

(6)#ͨ�� Elasticsearch-head �鿴 Elasticsearch ��Ϣͨ����������� http://192.168.49.11:9100/ ��ַ������Ⱥ�����������Ⱥ������ֵΪ green ��ɫ,����Ⱥ���ܽ��������������� ���Խ�localhost �ij�ip��ַ

(7)#��������

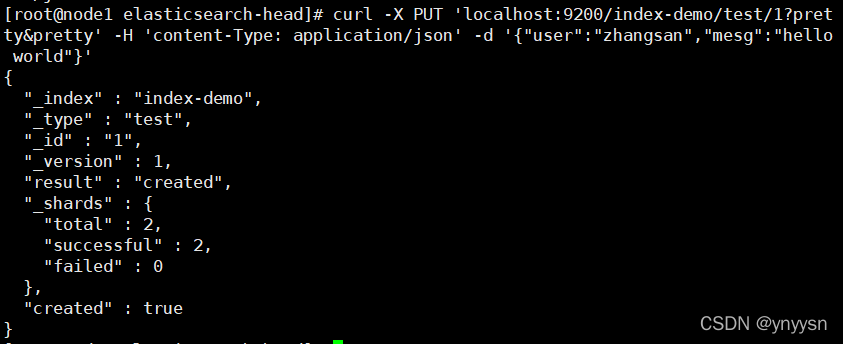

##��¼192.168.49.11 node1����##### ����Ϊindex-demo,����Ϊtest,���Կ����ɹ�����

[root@node1 ~]# curl -X PUT ��localhost:9200/index-demo/test/1?pretty&pretty�� -H ��content-Type: application/json�� -d ��{��user��:��zhangsan��,��mesg��:��hello world��}��

####ˢ����������뿴������Ϣ###

node1��Ϣ���� 01234

node2��Ϣ���� 01234

������ͼ���Կ�������Ĭ�ϱ���Ƭ5��,������һ������

�����������C�ᷢ����node1�ϴ���������Ϊindex-demo,����Ϊtest, ��ص���Ϣ

4.2 ELK Logstash ����(�� Apache �ڵ��ϲ���)

1.��װLogstash

(1)#��������

hostnamectl set-hostname apache

su

(2)#��װhttpd������

yum -y install httpd

systemctl start httpd

(3)#��װjava����

yum -y install java

java -version

(4)#��װlogstash

cd /opt

rpm -ivh logstash-5.5.1.rpm

systemctl start logstash.service

systemctl enable logstash.service

cd /usr/share/logstash/

ls

ln -s /usr/share/logstash/bin/logstash /usr/local/bin/

2.���� Logstash(Apache)��elasticsearch(node)�����Ƿ�����,���Խ�

Logstash����������

�ֶ���������:

�� -f ͨ�����ѡ�����ָ��logstash�������ļ�,���������ļ�����logstash

�� -e ��������ַ��� ���ַ������Ա�����logstash������(����ǡ��ա���Ĭ��ʹ��stdin��Ϊ���롢stdout��Ϊ���)

�� -t ���������ļ��Ƿ���ȷ,Ȼ���˳�

logstash -f �����ļ����� ȥ����elasticsearch

(1)#������ñ����� ������ñ��������¼192.168.49.13 ��Apache��������

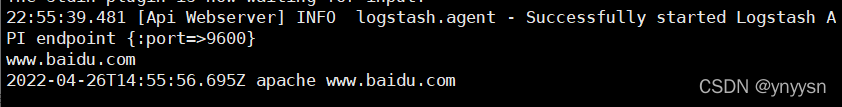

logstash -e ��input { stdin{} } output { stdout{} }��

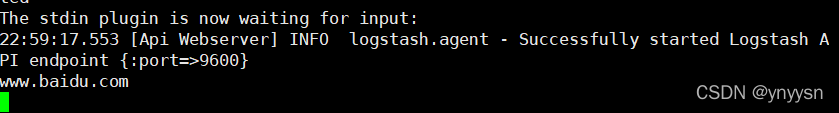

16:45:21.422 [[main]-pipeline-manager] INFO logstash.pipeline - Pipeline main started

16:45:21.645 [Api Webserver] INFO logstash.agent - Successfully started Logstash API endpoint {:port=>9600}

www.baidu.com ##��Ҫ�ֶ�����

2021-12-16T08:46:14.041Z apache www.baidu.com

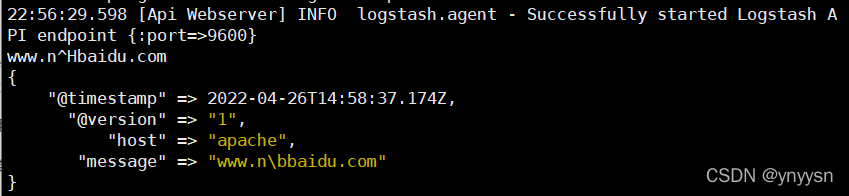

(2)#ʹ�� rubydebug �����ϸ��ʽ��ʾ,codec Ϊһ�ֱ������

logstash -e ��input { stdin{} } output { stdout{ codec=>rubydebug } }��

16:51:13.127 [[main]-pipeline-manager] INFO logstash.pipeline - Starting pipeline {��id��=>��main��, ��pipeline.workers��=>2, ��pipeline.batch.size��=>125, ��pipeline.batch.delay��=>5, ��pipeline.max_inflight��=>250}

16:51:13.174 [[main]-pipeline-manager] INFO logstash.pipeline - Pipeline main started

The stdin plugin is now waiting for input:

16:51:13.205 [Api Webserver] INFO logstash.agent - Successfully started Logstash API endpoint {:port=>9600}

www.baidu.com ##��Ҫ�ֶ�����

{

��@timestamp�� => 2021-12-16T08:52:22.528Z,

��@version�� => ��1��,

��host�� => ��apache��,

��message�� => ��www.baidu.com��

}

(3)##ʹ��logstash����Ϣд��elasticsearch��

logstash -e ��input { stdin{} } output { elasticsearch { hosts=>[��192.168.49.11:9200��] } }��

(1)#������ñ����� ������ñ��������¼192.168.49.13 ��Apache��������

(2)#ʹ�� rubydebug �����ϸ��ʽ��ʾ,codec Ϊһ�ֱ������

(3)##ʹ��logstash����Ϣд��elasticsearch��

3.���� logstash�����ļ�

Logstash �����ļ����������������:input��output �Լ� filter(��ѡ,������Ҫѡ��ʹ��)��

(1)#����־Ŀ¼�ɶ�Ȩ��

chmod o+r /var/log/messages #�� Logstash ���Զ�ȡ��־

(2)#�� Logstash �����ļ�,�����ռ�ϵͳ��־/var/log/messages,����������� elasticsearch �С�

vim /etc/logstash/conf.d/system.conf

input {

file{

path =>��/var/log/messages�� #ָ��Ҫ�ռ�����־��λ��

type =>��system�� #�Զ�����־���ͱ�ʶ

start_position =>��beginning�� #��ʾ�ӿ�ʼ���ռ�

}

}

output {

elasticsearch { #����� elasticsearch

hosts => [��192.168.49.11:9200��] #ָ�� elasticsearch �������ĵ�ַ�Ͷ˿�

index =>��system-%{+YYYY.MM.dd}�� #ָ������� elasticsearch ��������ʽ

}

}

input {

file{

path =>"/var/log/messages"

type =>"system"

start_position =>"beginning"

}

}

output {

elasticsearch {

hosts => ["192.168.49.11:9200"]

index =>"system-%{+YYYY.MM.dd}"

}

}

(4)#��������

systemctl restart logstash

(5)������� ����http://192.168.49.11:9100/ �鿴������Ϣ###

��� system-xxxx

4.3 ELK Kiabana ����(�� Node1 �ڵ��ϲ���)

(1)#��װ Kiabana

#�ϴ������� kibana-5.5.1-x86_64.rpm ��/optĿ¼

cd /opt

rpm -ivh kibana-5.5.1-x86_64.rpm

(2)#���� Kibana ���������ļ�

vim /etc/kibana/kibana.yml

�C2�Cȡ��ע��,Kiabana �����Ĭ�ϼ����˿�Ϊ5601

server.port: 5601

�C7�Cȡ��ע��,���� Kiabana �ļ�����ַ,0.0.0.0�������е�ַ

server.host: ��0.0.0.0��

�C21�Cȡ��ע��,���ú� Elasticsearch �������ӵĵ�ַ�Ͷ˿�

elasticsearch.url: ��http://192.168.59.115:9200��

�C30�Cȡ��ע��,������ elasticsearch ������.kibana����

kibana.index: ��.kibana��

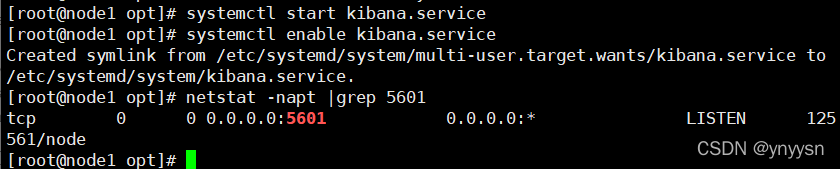

(3)#���� Kibana ����

systemctl start kibana.service

systemctl enable kibana.service

netstat -natp | grep 5601

(4)#��֤ Kibana

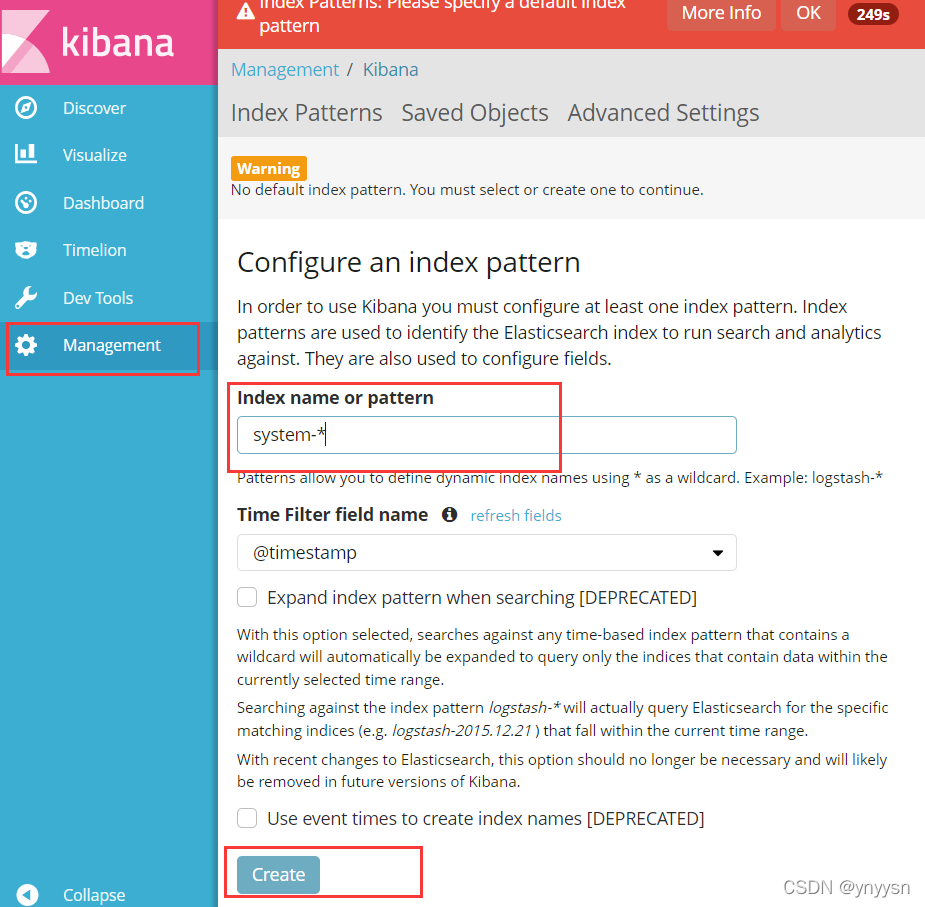

��������� http://192.168.49.11:5601

��һ�ε�¼��Ҫ����һ�� Elasticsearch ����:

Index name or pattern

//����:system-* #��������������֮ǰ���õ� Output ǰ��system��

���� ��create�� ��ť����,���� ��Discover�� ��ť�ɲ鿴ͼ����Ϣ����־��Ϣ��

����չʾ���Է�����ʾ,�ڡ�Available Fields���еġ�host��,Ȼ�� ��add����ť,���Կ������ա�host��ɸѡ��Ľ��

(5)#�� Apache ����������־(���ʵġ������)���ӵ� Elasticsearch ��ͨ�� Kibana ��ʾ

vim /etc/logstash/conf.d/apache_log.conf

input {

file{

path => "/etc/httpd/logs/access_log"

type => "access"

start_position => "beginning"

}

file{

path => "/etc/httpd/logs/error_log"

type => "error"

start_position => "beginning"

}

}

output {

if [type] == "access" {

elasticsearch {

hosts => ["192.168.49.11:9200"]

index => "apache_access-%{+YYYY.MM.dd}"

}

}

if [type] == "error" {

elasticsearch {

hosts => ["192.168.49.11:9200"]

index => "apache_error-%{+YYYY.MM.dd}"

}

}

}

cd /etc/logstash/conf.d/

/usr/share/logstash/bin/logstash -f apache_log.conf

6.#���������http://192.168.49.11:9100/����,�鿴������Ϣ�ܷ���

apache_error-time apache_access-time

#���������http://192.168.59.115:5601

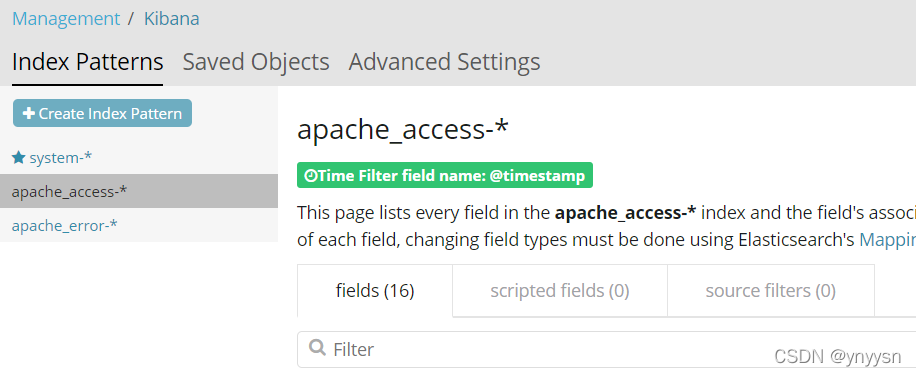

������½��и�managementѡ�index patterns��create index pattern

----�ֱ�apache_error-* �� apache_access-* ������