nginx��װ

Nginx��װ���,û��sbinĿ¼

cd���뵽nginx-1.18.0Ŀ¼��ִ��

[root@centos7?nginx-1.18.0]#?./configure?--prefix=/usr/local/nginx

[root@centos7?nginx-1.18.0]#?make

[root@centos7?nginx-1.18.0]#?make?install

ps:�Cprefix=path ����һ��Ŀ¼,��ŷ������ϵ��ļ� ,Ҳ����nginx�İ�װĿ¼,Ĭ��ʹ�� /usr/local/nginx

�ⲽ��ῴ��localĿ¼����һ�����㰲װ��nginx1.12.2ͬ����nginxĿ¼,�������sbinĿ¼�ˡ�

����ָ��

listen:��ָ�������������������

listen?*:80?|?*:8080??????#��������80�˿ں�8080�˿�

listen??IP_address:port???#����ָ���ĵ�ַ�Ͷ˿ں�

listen??IP_address????????#����ָ��ip��ַ���ж˿�

listen?port???????????????#�����ö˿ڵ�����IP����

server_name:��ָ�������������������á�

a. �������Ƶ�������������

server_name???name?...;

b. ���� IP ��ַ��������������

server_name?192.168.1.1

location:��ָ������ƥ�� URL��

locationָ��������Ǹ����û������URI��ִ�в�ͬ��Ӧ��,Ҳ���Ǹ����û��������վURL����ƥ��,ƥ��ɹ���������صIJ�����

location���

-

=��ͷ��ʾ��ȷƥ��

-

�� A ��ֻƥ���Ŀ¼��β������,���治�ܴ��κ��ַ�����

-

^~ ��ͷ��ʾuri��ij�������ַ�����ͷ,��������ƥ��

-

~ ��ͷ��ʾ���ִ�Сд������ƥ��;

-

~* ��ͷ��ʾ�����ִ�Сд������ƥ��

-

/ ͨ��ƥ��, ���û������ƥ��,�κ�����ƥ�䵽

Location������

#��ȷƥ��,/���治�ܴ��κ��ַ�

server?{

????????listen???????80;

????????server_name??www.itmayiedu.com;

????????#��ȷƥ��,ע����治�ܴ��κ��ַ�

????????location?=/?{

????????????proxy_pass?http://127.0.0.1:8080;

????????????index??index.html?index.htm;

????????}

}

?#ƥ��������/��ͷ����

server?{

????????listen???????80;

????????server_name??www.itmayiedu.com;

???????#ƥ��������/��ͷ����?

????????location?/?{

????????????proxy_pass?http://127.0.0.1:8080;

????????????index??index.html?index.htm;

????????}

????}

###??�Կ�ͷ/itmayiedu_8080����??Ĭ�Ͽ��������ִ�Сд

????server?{

????????listen???????80;

????????server_name??www.itmayiedu.com;

????????###??�Կ�ͷ/itmayiedu_8080?������ת��http://127.0.0.1:8080/;

????????location?/itmayiedu_8080/?{

????????????proxy_pass?http://127.0.0.1:8080/;

????????????index??index.html?index.htm;

????????}

????????###??�Կ�ͷ/itmayiedu_8080?������ת��http://127.0.0.1:8081/;

????????location?/itmayiedu_8081/?{

????????????proxy_pass?http://127.0.0.1:8081/;

????????????index??index.html?index.htm;

????????}

????}

###?��ͷ���ִ�Сд

proxy_pass:��ָ���������ñ������������ĵ�ַ���������������ơ�IP��ַ�Ӷ˿ںŵ���ʽ��

��ṹ����:

proxy_pass?URL;

index:��ָ������������վ��Ĭ����ҳ��

�����ض���

server

{

????listen?80?;

????server_name?mxiaoqi.top?aaa.com;

????if?(?$host?=?mxiaoqi.top?)

????#�����ж�����,������������mxiaoqi.top��ʱ��

????{

????????rewrite?/(.*)??http://aaa.com/$1?permanent;

????????#��mxiaoqi.top/�������������д��aaa.com/������������ж����ʹ��$2��$3�Դ�����

????????#permanent��ת��״̬��

????}

????index?index.html?index.htm?index.php;

????root?/data/wwwroot/mxiaoqi.top;

????}

�������

ʹ�� nginx ������� www.123.com ֱ����ת��127.0.0.1:8080

server?{

?????????listen???????80;

?????????server_name??www.123.com;

?????????location?/?{

?????????????proxy_pass?http://127.0.0.1:8080;

??????????????????????????#?��ӭҳ��,���մ����ҵ�˳�����ҳ��

?????????????index??index.html?index.htm?index.jsp;

?????????}

?????}

����80�˿�,��������Ϊwww.123.com,���Ӷ˿ں�ʱĬ��Ϊ80�˿�,�ʷ��ʸ�����ʱ����ת��127.0.0.1:8080·���ϡ�

��������

©Ͱ�㷨������Ͱ�㷨����:��Ҫ�������ڡ�©Ͱ�㷨���ܹ�ǿ���������ݵĴ�������,

��������Ͱ�㷨�����ܹ��������ݵ�ƽ������������,������ij�̶ֳȵ�ͻ�����䡣�ڡ�����Ͱ�㷨����,ֻҪ����Ͱ�д�������,��ô������ͻ���ش�������ֱ���ﵽ�û����õ�����,������ʺ��ھ���ͻ�����Ե�������

Nginx��������������ģ��ʹ�õ���©Ͱ�㷨,���ܹ�ǿ�б�֤�����ʵʱ�����ٶȲ��ᳬ�����õ���ֵ��

-

limit_req_zone �������Ƶ�λʱ���ڵ�������,����������,���õ�©Ͱ�㷨 "leaky bucket"��

-

limit_req_conn ��������ͬһʱ��������,���������ơ�

limit_req_zone ��������

Syntax:????limit_req?zone=name?[burst=number]?[nodelay];

Default:????��

Context:????http,?server,?location

limit_req_zone $binary_remote_addr zone=one:10m rate=1r/s;

-

��һ������:

$binary_remote_addr��ʾͨ��remote_addr�����ʶ��������,��binary_����Ŀ������д�ڴ�ռ����,������ͬһ�ͻ���ip��ַ�� -

�ڶ�������:zone=one:10m��ʾ����һ����СΪ10M,����Ϊone���ڴ�����,�����洢���ʵ�Ƶ����Ϣ��

-

����������:rate=1r/s��ʾ������ͬ��ʶ�Ŀͻ��˵ķ���Ƶ��,�������Ƶ���ÿ��1��,�������б���30r/m�ġ�

limit_req zone=one burst=5 nodelay;

-

��һ������:zone=one ����ʹ���ĸ�����������������,������limit_req_zone ���name��Ӧ��

-

�ڶ�������:burst=5,�ص�˵��һ���������,burst��������˼,������õ���˼������һ����СΪ5�Ļ��������д�������(����)����ʱ,�����˷���Ƶ�����Ƶ���������ȷŵ�����������ڡ�

-

����������:nodelay,�������,��������Ƶ�ζ��һ�����Ҳ���˵�ʱ��ͻ�ֱ�ӷ���503,���û������,�����������ȴ��Ŷӡ�

ngx_http_limit_conn_module ��������

���ģ���������Ƶ���IP�����������������е����Ӷ���������ֻ���ڷ������������������Ѿ���ȡ����������ͷʱ,���Ӳű�������

Syntax:????limit_conn?zone?number;

Default:????��

Context:????http,?server,?location

limit_conn_zone?$binary_remote_addr?zone=addr:10m;

server?{

????location?/download/?{

????????limit_conn?addr?1;

????}

һ��ֻ����ÿ��IP��ַһ�����ӡ�

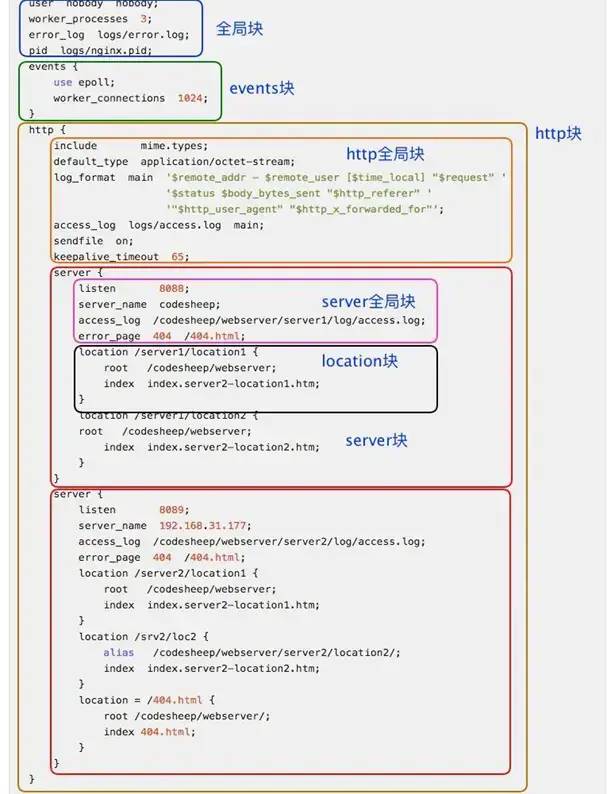

���ؾ���

#user??nobody;

worker_processes??1;

error_log??logs/error.log;#?������־

pid????????logs/nginx.pid;

...

????upstream?lyf?{

????server?192.168.37.220:8001;?#?3��tomcat����

????server?192.168.37.220:8002;

????server?192.168.37.220:8003;

????}

????server?{

????????listen???????80;

????????server_name??192.168.37.220;#?����ip

????????location?/?{

????????????proxy_pass???http://lyf;??#?����

????????????index??index.html?index.htm;

????????}

}

keepalive ���������������

keepalived :���ó����Ӵ���������

proxy_http_version :���ó�����http�汾Ϊ1.1

proxy_set_header :���connection header ��Ϣ

upstream?tomcats?{?

#?server?192.168.1.173:8080?max_fails=2?fail_timeout=1s;?

server?192.168.1.190:8080;?

#?server?192.168.1.174:8080?weight=1;?

#?server?192.168.1.175:8080?weight=1;?

keepalive?32;?

}

server?{

listen?80;?

server_name?www.tomcats.com;?

location?/?{?

proxy_pass?http://tomcats;?

proxy_http_version?1.1;?

proxy_set_header?Connection?"";?

}?

}

������ʽ

��ѯ��ʽ��Nginx����Ĭ�ϵķ�ʽ

Ȩ�ط�ʽ ָ��ÿ�������Ȩ�ر���,weight�ͷ��ʱ��ʳ�����

upstream??dalaoyang-server?{

???????server????localhost:10001?weight=1;

???????server????localhost:10002?weight=2;

}

iphash

ÿ�������ݷ���ip��hash�������,���������Ĵ���,ÿ���ÿ̶�����һ����˷���,��������(ip_hash���Ժ�weight���ʹ��)��

upstream??dalaoyang-server?{

???????ip_hash;?

???????server????localhost:10001?weight=1;

???????server????localhost:10002?weight=2;

}

��������

��������䵽���������ٵķ����ϡ�

upstream??dalaoyang-server?{

???????least_conn;

???????server????localhost:10001?weight=1;

???????server????localhost:10002?weight=2;

}

fair

����˷���������Ӧʱ������������,��Ӧʱ��̵����ȷ��䡣

upstream??dalaoyang-server?{

???????server????localhost:10001?weight=1;

???????server????localhost:10002?weight=2;

???????fair;??

}

Consul+upsync+Nginx ?ʵ������raload��̬���ؾ��� https://www.cnblogs.com/a1304908180/p/10697278.html

��ͳ�ĸ��ؾ���,���Upstream���������仯,ÿ�ζ���Ҫ���¼���nginx.conf�ļ�,

�����չ�Բ��Ǻܸ�,�������ǿ��Բ��ö�̬���ؾ���,ʵ��Upstream�����û�����̬��,�����˹����¼���nginx.conf��

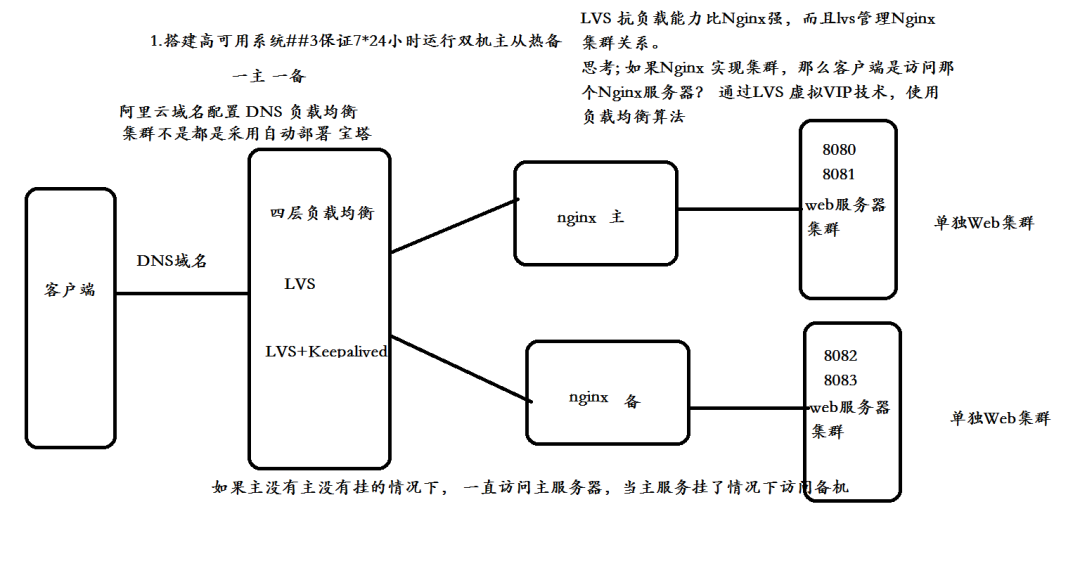

LVS+Keepalived+Nginx+Tomcat��߿���˫�������ȱ���Ⱥ

https://blog.csdn.net/dsen726/article/details/89519013

��Ҫ��ȷ����:

-

Nginx��̨��������ϵ,ֻ��һ̨�ڹ����������tomcat�Ǽ�Ⱥ,ͬʱ�����ġ�

-

keepalived��ͬʱ��װ����̨Nginx�ϵ�,�����ļ����ò�һ��

-

�����˫���ȱ���ָLVS,Nginx���Ǽ�Ⱥ

keepalived

��������ʧ���л���keepalived��������Ĺ��ܡ���ν�Ľ������,���Dz���tcp��������,icmp����,http����,udp echo����ȷ�ʽ�Ը��ؾ����������ʵ�ʵķ�����(ͨ���dz�����ʵҵ��ķ�����)���б���;��ʧ���л���Ҫ��Ӧ��������������ģʽ�ĸ��ؾ�����,����VRRPά���������ؾ�����������,�������ؾ�������������ʱ,�ɱ����ؾ��������ض�Ӧ��ҵ��,�Ӷ���������ϼ���������ʧ,���ṩ������ȶ��ԡ�

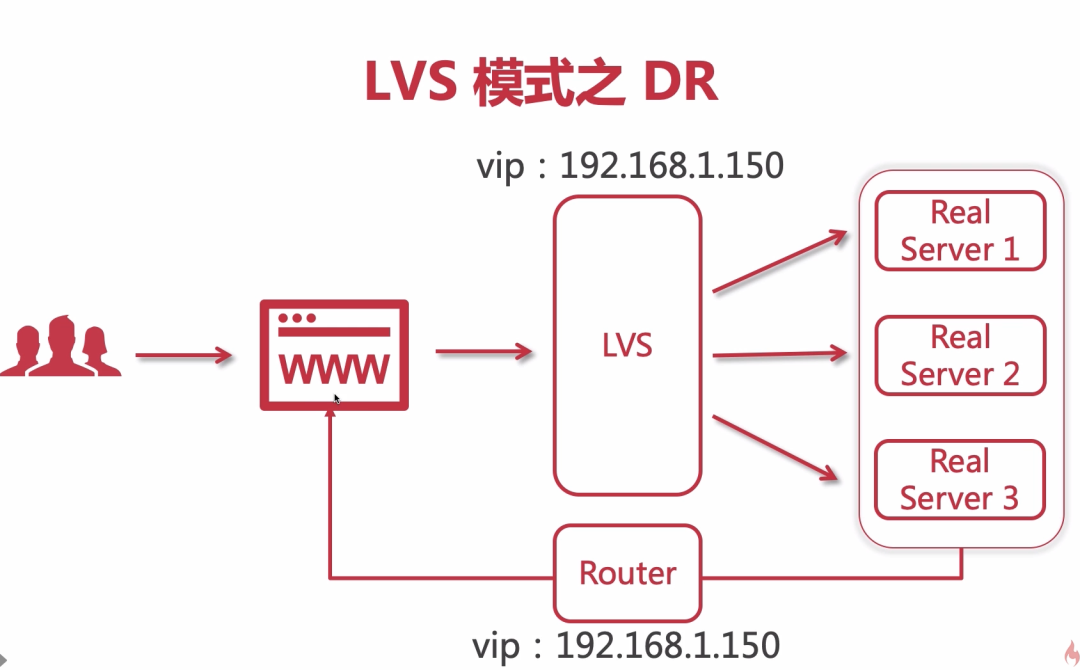

LVS��Linux Virtual Server�ļ�д,�⼴Linux���������,��һ������ķ�������Ⱥϵͳ��lvsĿǰ�Ǽ�����Linux�ڵġ�

ΪʲôҪLVS+Nginx?

һ��ngix(Ӧ�ò� �����߲㸺�ؾ���)

1���첽ת��,�������ݺ���Ӧ���ݶ�Ҫ����ngix,ngix�Ϳͻ��˽�������

2����ѯ���е�tomcat������,��֤����ɹ��������һ̨tomcat������Ҳ����ʧ��

����lvs(����� ?�����IJ㸺�ؾ���)

1��ͬ��ת��������������,lvsת����������,������ֱ�ӺͿͻ��˽�������

nginxҪ�������е�����,��һ̨nigx���ܲ���,����Ҫ�ngix��Ⱥ��ngix+ngix ����ngix����Ҫ��������������

lvs+ngix:lvsͬ��ת�����������Ӧ����,LVS����DRģʽʱ������Ӧ���������ص����ݡ�(ͨ�����������DZȽ�С��,��Ӧ���ݻ�Ƚϴ�)

��̬��Դ����

??location?~?.*\.(jpg|gif|png)$?{

????????gzip?on;

????????gzip_http_version?1.1;

????????gzip_comp_level?2;

????????gzip_types?text/plain?application/javascript?image/jpeg?image/gif?image/png;

????????root???/usr/share/nginx/images;

????}

????location?~?.*\.(txt|xml)$?{

????????gzip?on;

????????gzip_http_version?1.1;

????????gzip_comp_level?1;

????????gzip_types?text/plain?application/javascript?image/jpeg?image/gif?image/png;

????????root???/usr/share/nginx/code;

????}

??location?~?^/download?{

????????gzip_static?on;

????????tcp_nopush?on;

????????root?/opt/app/code;

????}

sendfile on | off,�ļ���ȡ����

Ĭ��sendfile�ǹرյ�,����������http,server,location,if in location��

tcp_nopush on | off,���������

Ĭ���ǹر�״̬,������http,server,location������,������������sendfile�����������,���������Ĵ���Ч�ʡ�ʲô��˼��,���������յ�����,��Ҫ����10����,Ϊ����ߴ���Ч��,��10��������һ��һ�����ظ��ͻ���,���ǽ�10�����ܹ��˺�һ�ػ�ȥ��

tcp_nodelay on | off,�������ʵʱ�Դ���

Ĭ�Ͽ���,������http,server,location������,������������keepalive������,���������Ĵ���ʵʱ�ԡ�

gzip on | off,ѹ��

Ĭ���ǹر�״̬,������http,server,location,if in location������,������ѹ�����䡣һ����˵������ǿ��Զ�ѹ��������ݽ��н�ѹ�ġ�

gzip_comp_level level;ѹ������

Ĭ�ϵ�ѹ��������1,������http,server,location������,�������õ�Խ��,ѹ����Խ��,����ѹ����ķѷ���˵ļ�����Դ,����Ҫ���ƺ�ѹ������

gzip_http_version 1.0 | 1.1,ѹ����httpЭ���֧��

Ĭ�϶�HTTP/1.1Э�������Ż����gzipѹ��,����������http,server,location�����á����û���Ҫ��ȡһ��1.html�ļ�,���Ȼ���Ŀ¼����Ѱ1.html.gz�Ƿ����,������͵����˴�����Դ���˷�,����Ҫ�洢�����ļ���

###��̬��Դ����

????server?{

??????listen???????80;

??????server_name??static.itmayiedu.com;

??????location?/static/imgs?{

???????????root?F:/;

???????????index??index.html?index.htm;

???????}

????}

???###��̬��Դ����

?????server?{

??????listen???????80;

??????server_name??www.itmayiedu.com;

??????location?/?{

?????????proxy_pass?http://127.0.0.1:8080;

?????????index??index.html?index.htm;

???????}

????}

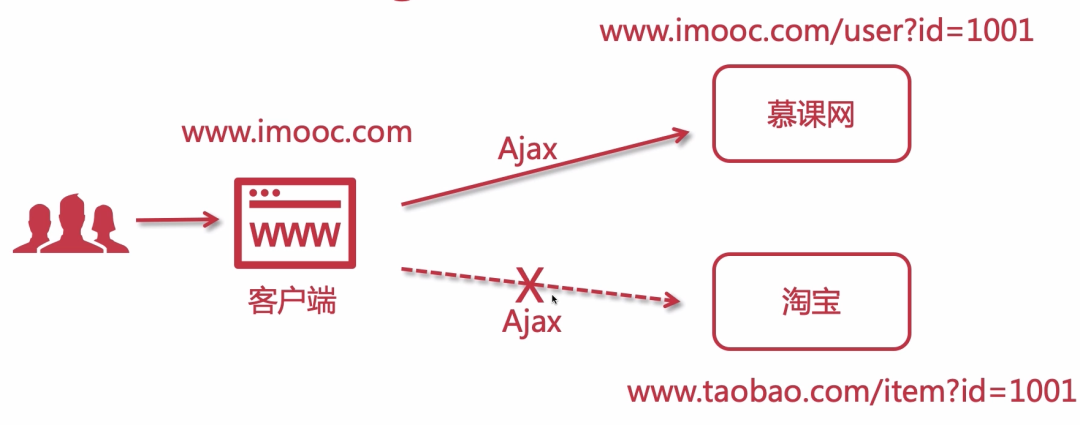

��������

���������ԭվ�����������ͬ������վ��,ͬԴ���Ի���ֹһ�����javascript�ű�������һ��������ݽ��н�������νͬԴ(��ָ��ͬһ����)��������ҳ�������ͬ��Э��(protocol),����(host)�Ͷ˿ں�(port)��

CORS �ǿ�����Դ����(Cross-Origin Resource Sharing)����д������ W3C ��,���ڿ�Դ AJAX ����ĸ������������

1����ͨ��������:ֻ�������������Access-Control-Allow-Origin

2����cookie��������:ǰ��˶���Ҫ��������

#���������������,*��������

add_header?'Access-Control-Allow-Origin'?*;

#��������cookie����?

add_header?'Access-Control-Allow-Credentials'?'true';?

#��������ķ���,����?GET/POST/PUT/DELETE?

add_header?'Access-Control-Allow-Methods'?*;?

#���������header?

add_header?'Access-Control-Allow-Headers'?*;

������

#��Դվ����֤

valid_referers?*.imooc.com;?

#�Ƿ����������·��ж�?

if?($invalid_referer)?{?return?404;?}

source: https://www.yuque.com/molizhuzhu/thrgrk/rtslmc